Wer: Redaktionen und digitale Inhalteplattformen. Was: Wie sich ein Medium so aufbauen lässt, dass es gezielt von KI‑Systemen aufgegriffen wird. Wann: im Kontext der aktuellen GenAI‑Entwicklung 2026. Wo: online, insbesondere in europäischen und globalen Plattform‑Ökosystemen. Warum: Multimodale Large Language Models und Retrieval‑Systeme ändern die Art der Informationsaufnahme und belohnen strukturierte, überprüfbare Inhalte.

Kurz: Es geht um eine Kombination aus redaktioneller Content‑Optimierung, technischer Datenstruktur und operativer Automatisierung, die ein Medium für Maschinelles Lernen sichtbar macht.

Aufbau: Technische Architektur und Datenstruktur für KI‑Aufnahme

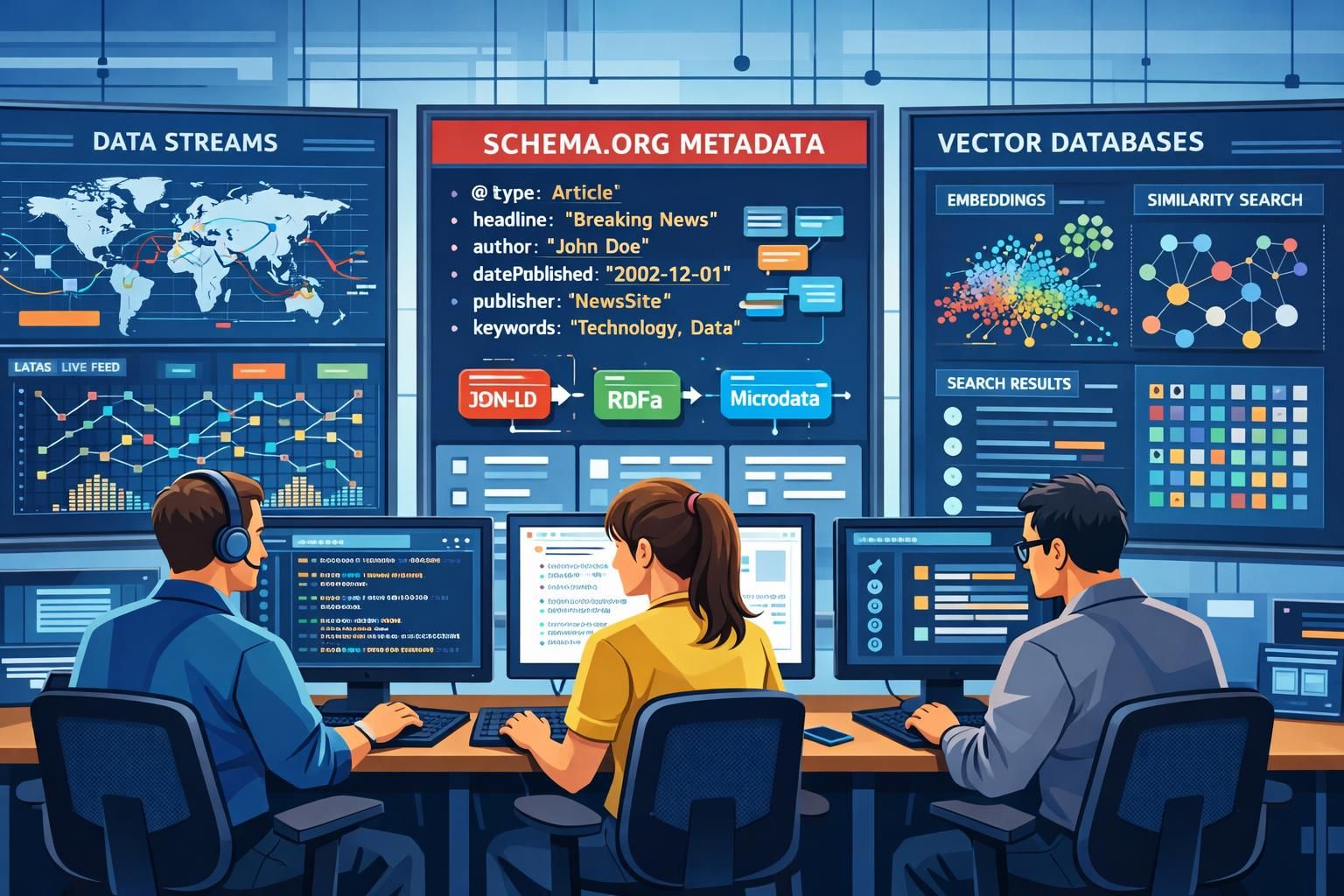

Ein tragfähiger Aufbau beginnt mit einer klaren technischen Architektur: strukturierte Metadaten, standardisierte URLs und maschinenlesbare Beschreibungen. Schema.org, OpenGraph‑Tags und leicht zugängliche APIs sind hierbei zentrale Bausteine.

Im Backend spielen Vektorbanken und Embeddings eine Schlüsselrolle für RAG‑Workflows (Retrieval Augmented Generation). Damit können Multimodale LLMs auf relevante Text‑ und Medienschnipsel zugreifen, ohne die gesamte Seite neu zu verarbeiten.

Technische Schritte, Beispiele und Auswirkungen

Praktisch bedeutet das: Inhalte in modularen, wiederverwendbaren Blöcken erstellen, Metadaten standardisieren und eine API‑Schicht für externe Zugriffe anbieten. Bekannte Modelle wie GPT‑4, LLaMA oder Claude greifen auf solche Strukturen zurück, wenn Anbieter RAG‑ oder Embedding‑Pipelines nutzen.

Ein konkreter Effekt: Besser strukturierte Inhalte erhöhen die Trefferwahrscheinlichkeit in KI‑Antworten und verbessern zugleich die Suchmaschinenoptimierung für klassische Indexer. Insight: Wer seine Datenstruktur vorbereitet, steigert die Auffindbarkeit in zwei Welten.

Gezielte Ansprache: Redaktionelle Prozesse und Content‑Optimierung

Die redaktionelle Umsetzung verlangt eine neue Balance zwischen journalistischer Sorgfalt und maschinenfreundlicher Aufbereitung. Gezielte Ansprache heißt, Leser:innen und KI‑Agenten gleichermaßen bedienen: klare Zusammenfassungen, strukturierte Faktenblöcke und Quellenangaben.

Automatisierungstools und Generative KI unterstützen bei der Produktion, sollten aber durch menschliche Review‑Prozesse ergänzt werden, um Qualität und Compliance sicherzustellen.

Prozesse, Governance und Beispiele

Organisationen etablieren Data‑Pipelines, in denen Inhalte vor der Veröffentlichung automatisch auf Vollständigkeit, Quellen und Bias geprüft werden. Beratungsansätze wie ein GenAI Readiness Assessment helfen, technische und organisatorische Lücken zu identifizieren.

Wichtig ist die Dokumentation der Informationsaufnahme und Provenienz: KI‑Systeme belohnen nachvollziehbare Quellen, was zugleich regulatorische Anforderungen wie Datenschutz und Transparenz unterstützt. Insight: Redaktionelle Standards sind jetzt zugleich Optimierungsregeln für KI.

Sichtbarkeit, Plattformen und regulatorische Rahmenbedingungen

Für die Distribution gilt: Kooperation mit Plattformen und Hyperscalern bringt Reichweite, birgt aber Risiken wie Vendor Lock‑In. Unternehmen wägen daher Cloud‑Lösungen gegen selbst gehostete Infrastrukturen ab, je nach Governance‑ und Datenschutzanforderungen.

Auf rechtlicher Ebene sind die DSGVO‑Prinzipien und der Entwurf des europäischen AI Act zu beachten; Anbieter müssen transparent machen, wenn Inhalte von KI erzeugt oder verstärkt wurden.

Metriken, Modellwahl und wirtschaftliche Folgen

Technische Bewertung erfolgt entlang von Metriken wie Genauigkeit (Precision/Recall, F1) und Betriebskennzahlen (TCO, Latenz). Beim Benchmarking werden Modelle wie PaLM2, Vicuna oder MPT herangezogen, um Performance und Kosten zu vergleichen.

Für den digitalen Markt bedeutet das: Medien, die Automatisierung und Governance integrieren, können Inhalte effizienter bereitstellen und zugleich Vertrauen bei Nutzer:innen und Regulatoren stärken. Insight: Sichtbarkeit in KI‑Systemen ist eine strategische Investition in Technik, Redaktion und Recht.